自学习算法实现高精度误差补偿

自学习算法实现高精度误差补偿是当前智能制造和精密控制领域的重要研究方向。随着工业4.0时代的到来,传统机械系统的静态误差补偿方法已难以满足现代制造对加工精度的严苛要求。本文将围绕该技术的核心原理、实现路径和应用价值展开深入探讨。

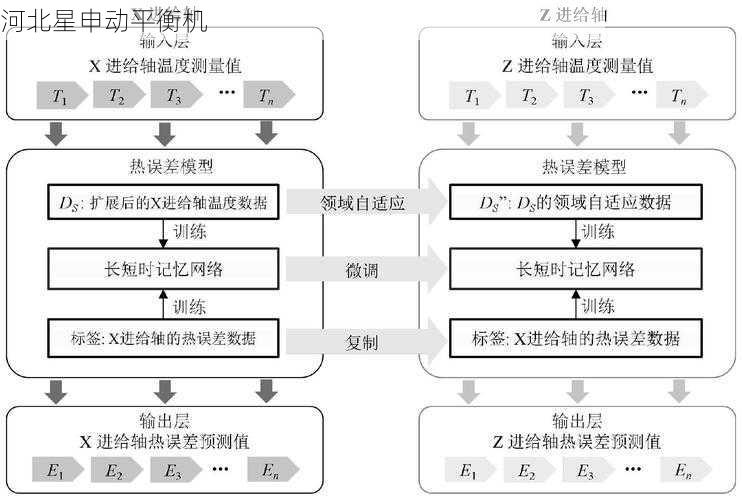

从技术本质来看,自学习算法区别于传统补偿方式的关键在于其动态适应能力。传统误差补偿通常基于预设的补偿表或固定参数模型,而自学习系统通过实时采集加工过程中的多维数据(包括温度、振动、切削力等),建立动态误差模型。典型的算法架构包含三个核心模块:数据采集层采用高精度传感器网络,以毫秒级频率采集设备状态信息;特征提取层运用小波变换等时频分析方法识别误差特征;最核心的补偿决策层则通过递归神经网络(RNN)或长短期记忆网络(LSTM)实现误差预测与补偿量计算。

在具体实现路径上,需要突破几个关键技术瓶颈。首先是多源异构数据的同步问题,不同传感器的采样频率和通信延迟会导致数据时序错位,采用时间戳对齐技术和卡尔曼滤波可有效解决。其次是模型泛化能力的提升,通过迁移学习将实验室环境训练的模型适配到实际车间,需要设计特殊的域适应算法。某机床企业的实测数据显示,经过300小时的自学习训练后,其五轴联动机床的重复定位精度从15μm提升***3μm,补偿效果随时间呈指数级改善。

该技术的应用价值主要体现在三个方面:在航空航天领域,某型号航空发动机叶片加工采用自学习补偿后,型面误差降低62%;在精密模具行业,注塑模具的配合间隙控制精度达到0.5μm级别;更值得注意的是在半导体设备中,晶圆对准系统的补偿响应时间缩短***50ms以内。这些应用案例证明,自学习算法不仅能补偿已知的系统误差,更能通过持续学习发现并修正潜在的未建模误差。

当前技术发展仍面临若干挑战。数据安全方面,连续学习过程可能泄露设备的核心工艺参数,需要开发联邦学习框架。实时性方面,边缘计算设备的算力限制影响着补偿时效性,算法轻量化是重点突破方向。某研究院的实验表明,将深度学习模型量化为8位整数后,推理速度提升3倍而精度损失仅0.2%。这些技术痛点的解决将推动自学习补偿向更广泛的工业场景渗透。

展望未来,随着数字孪生技术的成熟,自学习算法将与虚拟仿真深度结合。通过在数字空间中预训练补偿模型,再部署到物理设备,可大幅缩短学习周期。预计到2025年,采用第三代自学习算法的数控系统将实现亚微米级自主精度补偿,这将对精密制造工艺带来革命性变革。值得注意的是,这种技术的普及还需要建立相应的行业标准,包括数据接口规范、算法可靠性认证体系等,这些都需要产学研各界的协同推进。